워드프레스 사이트를 운영하면 robots.txt 파일이 없어도 검색 엔진이 알아서 크롤링 해 색인하지만 robots.txt 파일을 만들어주는 게 최적화 작업 중 기본입니다. robots.txt 파일을 참조하여 검색 엔진 크롤러(봇)가 웹 페이지 수집 시 참고하기 때문입니다.

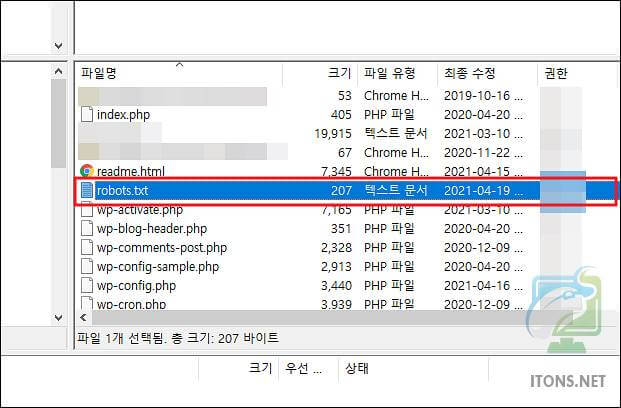

robots.txt 파일 위치

robots.txt 파일은 아래와 같이 도메인 최상위 도메인 루트 디렉터리에 위치해야 합니다.

예) https://도메인/robots.txt

아래 화면은 파일질라 FTP 프로그램으로 접속한 워드프레스 루트 디렉터리입니다.

robots 파일 만들기 – 규칙

robots.txt 파일은 아주 쉽고 간단한 형식으로 만들 수 있습니다.

어려운 프로토콜 및 규칙이 없기 때문에 알고 보면 쉬운 규칙을 가지고 있습니다.

User-agent 는 검색 엔진 로봇 이름으로 * 를 붙이면 모든 검색 엔진 로봇을 말합니다.

User-agent: *

예를들어 네이버 검색 로봇 이름은 다음과 같습니다.

User-agent: Yeti

모든 검색엔진의 로봇에 대해 웹 문서 수집 및 색인 허용합니다.

User-agent: * Allow: /

혹은 Disallow 명령어에 / 경로가 없어도 수집 및 색인을 허용합니다.

User-agent: * Disallow:

Disallow 명령어에 / 경로를 붙이면 모든 웹문서 수집 및 색인을 허용하지 않습니다.

User-agent: * Disallow: /

특정 폴더 색인을 허용하지 않습니다.

User-agent: * Disallow: /sfolder/

특정 파일을 제외하여 폴더 색인을 허용하지 않습니다.

User-agent: * Disallow: /sfolder/ Allow: /sfolder/sample.html

사이트맵을 지정합니다. 사이트맵은 xml 파일이며 여러 개 추가 가능합니다. 검색로봇이 사이트의 콘텐츠를 더 잘 수집할 수 있도록 도와줄 수 있습니다.

사이트맵은 네이버 서치 어드바이저나 구글 서치 콘솔 등 웹마스터에 등록되어 있다면 굳이 작성하지 않아도 됩니다.

User-agent: * Sitemap: https://sample.com/sitemap.xml // 실제 사이트맵 주소로 교체하세요.

워드프레스 기본 robots.txt

워드프레스 기본 robots.txt 파일입니다. 꼭 정답은 아니지만 위에 설명드린 내용을 참고하셔서 작성하시거나 그냥 적용하셔도 됩니다.

User-Agent: * Disallow: /wp-admin/ Allow: /wp-admin/admin-ajax.php

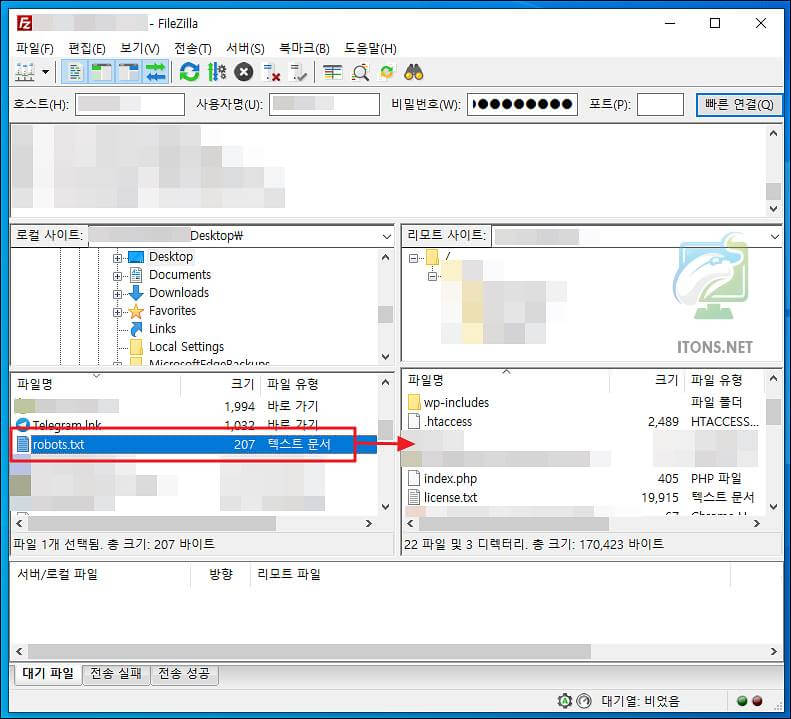

워드프레스 루트 robots.txt 전송

워드프레스 루트 경로에 robots.txt 파일을 파일질라 FTP 프로그램 등으로 전송합니다.

이런 식으로 검색엔진 수집 및 색인을 제어할 수 있지만 더 확실한 방법은 robots 메타태그 index, noindex 를 활용하면 됩니다.

<head> <meta name="robots" content="index"> // 색인 허용 <meta name="robots" content="noindex"> // 색인불허용 </head>

SEO 플러그인을 활용하신다면 robots 메타태그를 더 손쉽게 제어할 수 있습니다.